- Как быстро найти и удалить все дубли страниц на сайте: 8 способов + лайфхак

- Виды дублей

- Полные

- Частичные

- Характеристики в карточке товара

- Пагинация

- Подстановка контента

- Версия для печати

- Смысловые

- Варианты устранения дубликатов

- Физическое удаление

- Настройка 301 редиректа

- Создание канонической страницы

- Запрет индексации файла Robots.txt

- Причины возникновения

- Как дубликаты влияют на позиции сайта

- Инструменты для поиска

- Яндекс.Вебмастер

- Netpeak Spider

- Screaming Frog Seo Spider

- Сервис-лайфхак

- Вывод

- Что такое дубли на сайте и как с ними бороться?

- В чем опасность дублей

- Явные дубли (страница доступна по двум или более URL)

- 1. URL со слешем в конце и без него

- 2. URL с WWW и без WWW

- Как указать главное зеркало в Яндексе

- Как склеить зеркала в Google

- 3. Адреса с HTTP и HTTPS

- 4. Адреса с GET-параметрами

- 5. Один и тот же товар, доступный по разным адресам

- 6. Версии для печати

- Ищите свой вариант работы с дублями

- Неявные дубли (контент на нескольких страницах различается, но незначительно)

- 1. Дубли древовидных комментариев (replytocom)

- 2. Страницы товаров со схожими описаниями

- 3. Страницы пагинации

- Как выявить дубли страниц

- Способ 1. «Ручной»

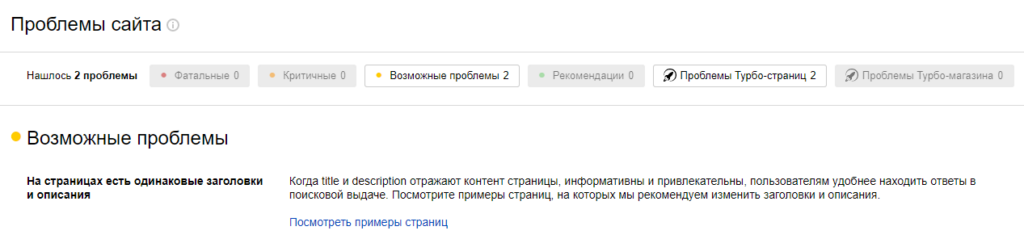

- Способ 2. Яндекс.Вебмастер

- Способ 3. Парсинг проиндексированных страниц

- Если нет времени/опыта разбираться с дублями

Как быстро найти и удалить все дубли страниц на сайте: 8 способов + лайфхак

Дубли — это страницы с одинаковым контентом. Они могут появиться при автогенерации, некорректных настройках, вследствие изменения структуры сайта или при неправильной кластеризации. Дубликаты негативно влияют на SEO-продвижение, так как поисковые системы хуже ранжируют страницы с похожим контентом. Кроме того, большое количество слабых, несодержательных или пустых страниц понижают оценку всего сайта. Поэтому важно своевременно отслеживать и устранять подобные проблемы.

В данной статье подробно рассмотрим, как найти и удалить дубли, а также предотвратить их появление.

Виды дублей

Дубликаты бывают 3-х видов:

- Полные — с полностью одинаковым контентом;

- Частичные — с частично повторяющимся контентом;

- Смысловые, когда несколько страниц несут один смысл, но разными словами.

Зачастую при анализе обращают внимание лишь на полные совпадения, но не стоит забывать про частичные и смысловые, так как к ним поисковики тоже относятся критично.

Полные

Полные дубли ухудшают хостовые факторы всего сайта и осложняют его продвижение в ТОП, поэтому от них нужно избавиться сразу после обнаружения.

К ним относятся:

- Версия с/без www. Возникает, если пользователь не указал зеркало в панели Яндекса и Google.

- Различные варианты главной страницы:

- site.net;

- site.net/index;

- site.net/index/;

- site.net/index.html;

- Страницы, появившиеся вследствие неправильной иерархии разделов:

- site.net/products/gift/

- site.net/products/category/gift/

- site.net/category/gift/

- UTM-метки. Метки используются, чтобы передавать данные для анализа рекламы и источника переходов. Обычно они не индексируются поисковиками, но бывают исключения.

- GET-параметры в URL. Иногда при передаче данных GET-параметры попадают в адрес страницы:

- site.net/products/gift/page.php?color=red

- Страницы, сгенерированные реферальной ссылкой. Обычно они содержат специальный параметр, который добавляется к URL. С такой ссылки должен стоять редирект на обычный URL, однако часто этим пренебрегают.

- Неправильно настроенная страница с ошибкой 404, которая провоцирует бесконечные дубли. Любой случайный набор символов в адресе сайта станет ссылкой и без редиректа отобразится как страница 404.

Избавиться от полных дубликатов можно, поставив редирект, убрав ошибку программно или закрыв документы от индексации.

Частичные

Частичные дубликаты оказывают не такое сильное влияние на сайт, как полные. Однако если их много — это ухудшает ранжирование веб-ресурса. Кроме того, они могут мешать продвижению и по конкретным ключевым запросам. Разберем в каких случаях они возникают.

Характеристики в карточке товара

Нередко, переключаясь на вкладку в товарной карточке, например, на отзывы, можно увидеть, как это меняет URL-адрес. При этом большая часть контента страницы остаётся прежней, что создает дубль.

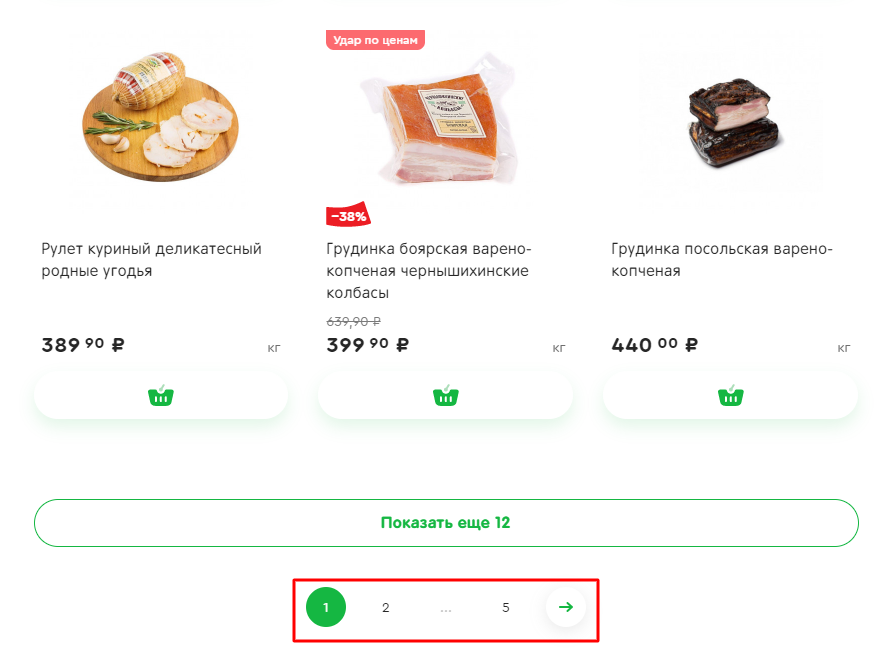

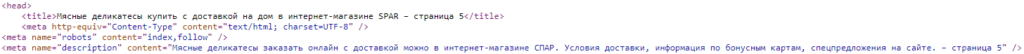

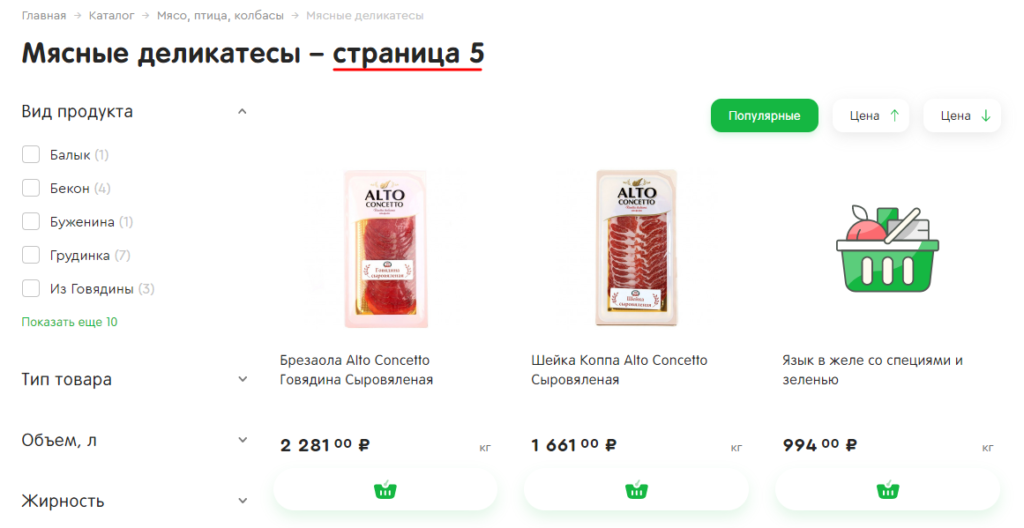

Пагинация

Если CMS неправильно настроена, переход на следующую страницу в категории меняет URL, но не изменяет Title и Description. В итоге получается несколько разных ссылок с одинаковыми мета-тегами:

Такие URL-адреса поисковики индексируют как отдельные документы. Чтобы избежать дублирования, проверьте техническую реализацию вывода товаров и автогенерации.

Также на каждой странице пагинации необходимо указать каноническую страницу, которая будет считаться главной. Как указать этот атрибут, будет рассмотрено ниже.

Подстановка контента

Часто для повышения видимости по запросам с указанием города в шапку сайта добавляют выбор региона. При нажатии которого на странице меняется номер телефона. Бывают случаи, когда в адрес добавляется аргумент, например «wt_city_by_default=..». В результате, у каждой страницы появляется несколько одинаковых версий с разными ссылками. Не допускайте подобной генерации или используйте 301 редирект.

Версия для печати

Версии для печати полностью копируют контент и нужны для преобразования формата содержимого. Пример:

- site.net/blog/content

- site.net/blog/content/print – версия для печати;

Поэтому необходимо закрывать их от индексации в robots.txt.

Смысловые

Смысловые дубли — это статьи, написанные под запросы из одного кластера. Чтобы их обнаружить, нужно воспользоваться результатом парсинга сайта, выполненного, например, программой Screaming Frog. Затем скопировать заголовки всех статей и добавить их в любой Hard-кластеризатор с порогом группировки 3,4. Если несколько статей попали в один кластер – оставьте наиболее качественную, а с остальных поставьте 301 редирект.

Варианты устранения дубликатов

При дублировании важно не только избавиться от копий, но и предотвратить появление новых.

Физическое удаление

Самым простым способом было бы удалить повторяющиеся страницы вручную. Однако перед удалением нужно учитывать несколько важных моментов:

- Источник возникновения. Зачастую физическое удаление не решает проблему, поэтому ищите причину;

- Страницы можно удалять, только если вы уверены, что на них не ссылаются другие ресурсы. Проверить это можно с помощью условно-бесплатного инструмента.

Настройка 301 редиректа

Если дублей не много или на них есть ссылки, настройте редирект на главную или продвигаемую страницу. Настройка осуществляется через редактирование файла . htaccess либо с помощью плагинов. Старый документ со временем выпадет из индекса, а весь ссылочный вес перейдет новой странице.

Создание канонической страницы

Указав каноническую страницу, вы показываете поисковым системам, какой документ считать основным. Этот способ используется для того, чтобы показать, какую страницу нужно индексировать при пагинации, сортировке, попадании в URL GET-параметров и UTM-меток. Для этого на всех дублях в теге прописывается следующая строчка со ссылкой на оригинальную страницу:

Например, на странице пагинации главной должна считаться только одна страница: первая или «Показать все». На остальных необходимо прописать атрибут rel=»canonical», также можно использовать теги rel=prev/next.

Для 1-ой страницы:

Для второй и последующей:

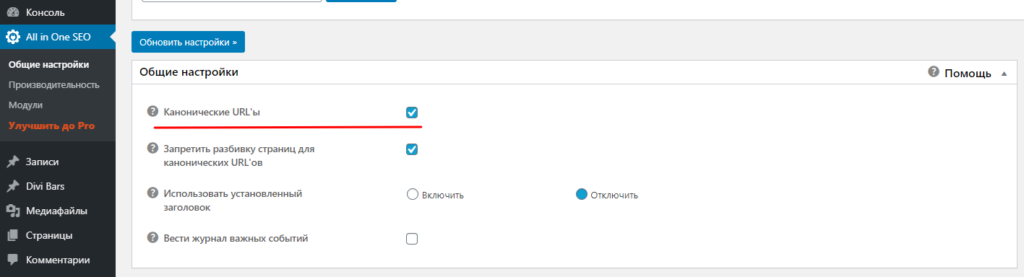

Для решения этой задачи на сайтах WordPress используйте плагины Yoast SEO или All in One SEO Pack. Чтобы все заработало просто зайдите в настройки плагина и отметьте пункт «Канонические URL».

Запрет индексации файла Robots.txt

Файле robots.txt — это своеобразная инструкция по индексации для поисковиков. Она подойдёт, чтобы запретить индексацию служебных страниц и дублей.

Для этого нужно воспользоваться директивой Disallow, которая запрещает поисковому роботу индексацию.

Disallow: /dir/ – директория dir запрещена для индексации

Disallow: /dir – директория dir и все вложенные документы запрещены для индексации

Disallow: *XXX – все страницы, в URL которых встречается набор символов XXX, запрещены для индексации.

Внимательно следите за тем какие директивы вы прописываете в robots. П ри некорректном написании можно заблокировать не те разделы либо вовсе закрыть сайт от поисковых систем.

Запрет индексировать страницы действует для всех роботов. Но каждый из них реагирует на директиву Disallow по-разному: Яндекс со временем удалит из индекса запрещенные страницы, а Google может проигнорировать правило, если на данный документ ведут ссылки.

Причины возникновения

Обычно при взгляде на URL-адрес можно сразу определить причину возникновения дубля. Но иногда нужен более детальный анализ и знание особенностей CMS. Ниже приведены 6 основных причин, почему они могут появляться:

- ID-сессии, которые нужны, чтобы контролировать действия юзеров или анализировать данные о товарах в корзине.

- Особенности CMS. Joomla создаёт большое количество дублей, в отличие, например, от WordPress .

- Ссылки с GET-параметрами.

- Страницы комментариев.

- Документы для печати.

- Документы с www и без www.

Некоторые ошибки могут появиться и по другим причинам, например, если не указан редирект со старой страницы на новую или из-за особенностей конкретных скриптов и плагинов. С каждой такой проблемой нужно разбираться индивидуально.

Отдельным пунктом можно выделить страницы, дублирующиеся по смыслу. Такая ошибка часто встречается при неправильной разгруппировке. Подробнее о том как ее не сделать читайте по ссылке.

Как дубликаты влияют на позиции сайта

Дубли существенно затрудняют SEO- продвижение и могут стать препятствием для выхода запросов в ТОП поисковой выдачи.

Чем же они так опасны:

- Снижают релевантность страниц. Если поисковик замечает несколько url-ов с одинаковым контентом, их релевантность снижается и оба документа начинают ранжироваться хуже.

- Уменьшают процент уникальности текстов. Уникальность будет разделена между дублирующими документами, а значит копия будет неуникальной по отношению к основной странице. В итоге общая уникальность сайта понизится.

- Разделяют вес. Поисковик показывает по одному запросу только 1 станицу сайта (если он не витальный), поэтому наличие нескольких документов снижает вес каждого урла.

- Увеличивают время индексации. Поисковый робот дольше сканирует веб-ресурс из-за большого количества документов.

Инструменты для поиска

Как найти дублирующие ся документы? Это можно сделать с помощью программ и онлайн-сервисов. Часть из них платные, другие – бесплатные, некоторые – условно-бесплатные (с пробной версией или ограниченным функционалом).

Яндекс.Вебмастер

Чтобы посмотреть наличие дубликатов в панели Яндекса, необходимо:

- выбрать вкладку «Индексирование»;

- открыть раздел «Страницы в поиске»;

- посмотреть количество «Исключенных страниц».

Страницы исключаются из индекса по разным причинам, в том числе из-за повторяющегося контента. Обычно конкретная причина прописана под ссылкой.

Netpeak Spider

Netpeak Spider – платная программа с 14-дневной пробной версией. Если провести поиск по заданному сайту, программа покажет все найденные ошибки и дубликаты.

Бесплатным аналогом этих программ является Xenu, где можно проанализировать даже не проиндексированный сайт.

При сканировании программа найдет повторяющиеся заголовки и мета-описания.

Screaming Frog Seo Spider

Screaming Frog Seo Spider является условно-бесплатной программой. До 500 ссылок можно проверить бесплатно, после чего понадобится платная версия. Наличие дублей программа определяет так же, как и Xenu, но быстрее и эффективнее. Если нет денег на покупку рабочий ключ можно найти в сети.

Сервис-лайфхак

Для тех кто не хочет осваивать программы, рекомендую воспользоваться техническим анализом от Wizard.Sape. Аудит делается в автоматическом режиме в среднем за 2-4 часа. Цена вопроса — 690 рублей. В течении 30 дней бесплатно можно провести повторную проверку.

Помимо дублированного контента и мета-тегов инструмент выдает много полезной информации:

- показывает все 301 редиректы;

- обрабатку заранее ошибочных адресов;

- страницы на которых нет контента;

- битые внешние и внутренние ссылки и картинки.

Вывод

Полные и частичные дубли значительно осложняют продвижение сайта. Поэтому обязательно проверяйте ресурс на дубликаты, как сгенерированные, так и смысловые и применяйте описанные в статье методы для их устранения.

Источник

Что такое дубли на сайте и как с ними бороться?

Виды, причины и способы устранения

Явные и неявные дубли на сайте затрудняют индексацию, ломают планы по продвижению и могут «подарить» вебмастеру часы и часы работы по их удалению. Как избежать проблем и вовремя их ликвидировать? Рассказываем в статье.

Дубли — это страницы на одном и том же домене с идентичным или очень похожим содержимым. Чаще всего появляются из-за особенностей работы CMS, ошибок в директивах robots.txt или в настройке 301 редиректов.

Появления дублей можно избежать на начальном этапе технической оптимизации сайта, еще до того, как он начнет индексироваться. Для каждого типа описали свои способы профилактики. Если значительная часть страниц-дублей с вашего ресурса уже попала в индекс, распределите их по типам, проведите работу по устранению и поисковики сами постепенно удалят их из выдачи.

В чем опасность дублей

1. Неправильная идентификация релевантной страницы поисковым роботом. Допустим, у вас одна и та же страница доступна по двум URL:

Вы вкладывали деньги в продвижение страницы https://site.ru/kepki/. Теперь на нее ссылаются тематические ресурсы, и она заняла позиции в ТОП10. Но в какой-то момент робот исключает ее из индекса и взамен добавляет https://site.ru/catalog/kepki/. Естественно, эта страница ранжируется хуже и привлекает меньше трафика.

2. Увеличение времени, необходимого на переобход сайта роботами. На сканирование каждого ресурса у поисковых роботов есть краулинговый бюджет — максимальное число страниц, которое робот может посетить за определенный отрезок времени. Если на сайте много дублей, робот может так и не добраться до основного контента, из-за чего его индексация затянется. Эта проблема особенно актуальна для сайтов с тысячами страниц.

3. Наложение санкций поисковых систем. Сами по себе дубли не являются поводом к пессимизации сайта — до тех пор, пока поисковые алгоритмы не посчитают, что вы создаете дубли намеренно с целью манипуляции выдачей.

4. Проблемы для вебмастера. Если работу над устранением дублей откладывать в долгий ящик, их может накопиться такое количество, что вебмастеру чисто физически будет сложно обработать отчеты, систематизировать причины дублей и внести корректировки. Большой объем работы повышает риск ошибок.

Дубли условно делятся на две группы: явные и неявные.

Явные дубли (страница доступна по двум или более URL)

Вариантов таких дублей много, но все они похожи по своей сути. Вот самые распространенные.

1. URL со слешем в конце и без него

Что делать: настроить ответ сервера «HTTP 301 Moved Permanently» (301-й редирект).

Как это сделать:

- найти в корневой папке сайта файл .htaccess и открыть (если его нет — создать в формате TXT, назвать .htaccess и поместить в корень сайта);

- прописать в файле команды для редиректа с URL со слешем на URL без слеша:

- обратная операция:

- если файл создается с нуля, все редиректы необходимо прописывать внутри таких строк:

Настройка 301 редиректа с помощью .htaccess подходит только для сайтов на Apache. Для nginx и других серверов редирект настраивается другими способами.

Какой URL предпочтителен — со слешем или без? Чисто технически — никакой разницы. Смотрите по ситуации: если проиндексировано больше страниц со слешем, оставляйте этот вариант, и наоборот.

2. URL с WWW и без WWW

Что делать: указать на главное зеркало сайта в Яндекс.Вебмастере, настроить 301 редирект и канонические URL.

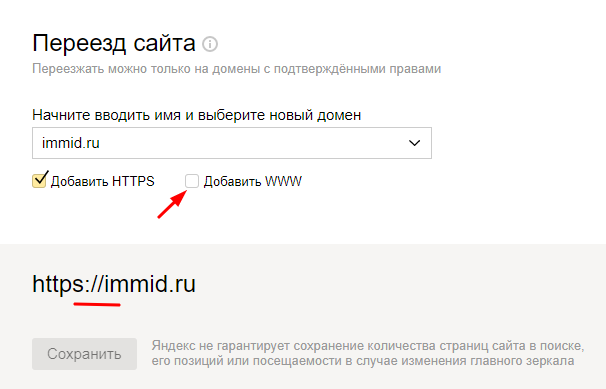

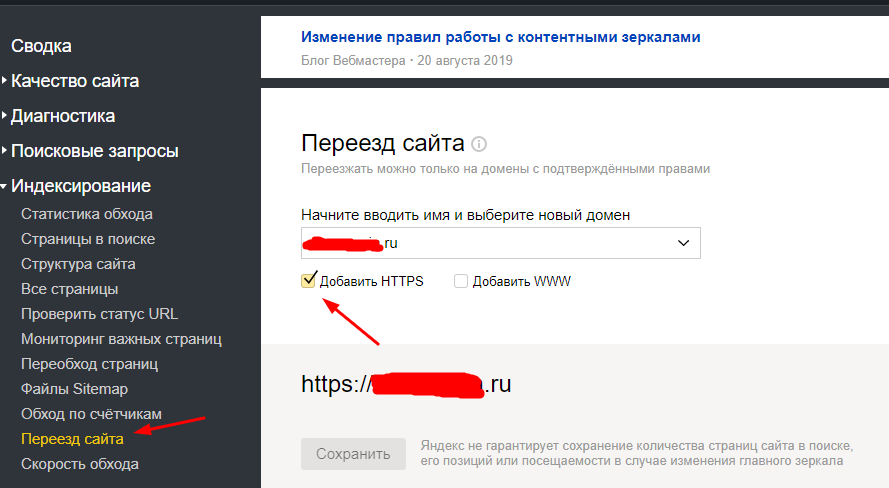

Как указать главное зеркало в Яндексе

- перейти в Яндекс.Вебмастер и добавить 2 версии сайта — с WWW и без WWW;

- выбрать в Панели сайт, с которого будет идти перенаправление (чаще всего перенаправляют на URL без WWW);

- перейти в раздел «Индексирование / Переезд сайта», убрать галочку напротив пункта «Добавить WWW» и сохранить изменения.

В течение 1,5 – 2 недель Яндекс склеит зеркала, переиндексирует страницы, и в поиске появятся только URL без WWW.

Важно! Ранее для указания на главное зеркало в файле robots.txt необходимо было прописывать директиву Host. Но она больше не поддерживается. Некоторые вебмастера «для подстраховки» до сих пор указывают эту директиву – в этом нет необходимости, достаточно настроить склейку в Вебмастере.

Как склеить зеркала в Google

Раньше можно было подтвердить права в Google Search Console на обе версии ресурса (с WWW и без WWW) и указать Google предпочтительный адрес в разделе «Настройки сайта». В 2020-м году это уже не работает.

Указать поисковику на главное зеркало можно двумя способами:

- Настроить 301 редирект на предпочтительную версию. Если вы не сделали это сразу же после того, как открыли сайт для индексации, проанализируйте, каких страниц больше в индексе Google и настраивайте переадресацию на этот вариант URL.

- Согласно рекомендациям Google, настроить канонические страницы: добавить в код тег

- с атрибутом rel=»canonical» или включить в ответ страниц HTTP-заголовок rel=canonical.

Анализ индексации страниц — инструмент, который поможет локализовать большинство проблем с индексацией. Проверяет обе поисковые системы. Быстро покажет косяки индексации.

3. Адреса с HTTP и HTTPS

Сайты с SSL-сертификатами получают преимущество в результатах выдачи. Но из-за ошибок при переходе на HTTPS появляются дубли:

Что делать:

1. Проверить, корректно ли склеены зеркала в Яндексе (процедура аналогична склейке зеркал с WWW и без WWW, с той лишь разницей, что в главном зеркале нужно установить галочку «Добавить HTTPS»).

2. Проверить, правильно ли настроены редиректы. Возможно, в использованном коде есть ошибки. У нас есть пошаговая инструкция по настройке HTTPS, где даны все необходимые команды для редиректов.

Важно! Если с момента настройки HTTPS прошло менее 2 недель, не стоит бить тревогу — подождите еще неделю-другую. Поисковикам нужно время, чтобы убрать из индекса старые адреса.

4. Адреса с GET-параметрами

Все, что идет в URL после знака ?, называется GET-параметрами. Эти параметры разделяются между собой знаком &. Каждый новый URL с GET-параметрами является дублем исходной страницы.

Что делать:

Вариант 1. Запретить индексацию страниц с GET-параметрами в robots.txt. Выглядеть запрет будет так (для всех роботов):

Вариант 2. Яндекс поддерживает специальную директиву Clean-param для robots.txt, которая дает команду роботу не индексировать страницы с GET-параметрами. Ее преимущество в том, что если исходная страница по какой-то причине не проиндексирована, то робот по директиве Clean-param узнает о ее существовании и добавит в индекс. Если же закрыть от индексации страницы с GET-параметрами с помощью директивы Disallow, то робот даже не будет обращаться к этим страницам, и исходная страница так и останется не проиндексированной.

Подробная информация об использовании директивы – в Справке Яндекса.

Проблема в том, что директива Clean-param применяется в Яндексе, и Google не понимает ее. Поэтому решение такое: для Яндекса используем Clean-param, для Google — Disallow:

5. Один и тот же товар, доступный по разным адресам

Что делать: настроить атрибут rel=»canonical» для тега

. Этот атрибут указывает на надежную (каноническую) страницу. Именно такая страница попадет в индекс.

Пример. Допустим, вам нужно указать роботу, чтобы он индексировал страницу http://site.ru/catalog/sony-ps-4. То есть именно она является канонической, а страница http://site.ru/sony-ps-4 — копией. В этом случае необходимо в раздел страницы-копии (и всех прочих страниц-копий, если они есть), добавить такую строку:

Так вы со страницы-копии ссылаетесь на каноническую страницу, которая и будет индексироваться.

Настраивается rel=»canonical» средствами PHP, с помощью встроенных функций CMS или плагинов. Например, для WordPress есть плагин All in One SEO Pack, который позволяет управлять каноническими URL в автоматическом и ручном режиме:

6. Версии для печати

Основной текстовый контент исходной страницы и версии для печати совпадает, поэтому такие страницы считаются дублями.

Что делать: закрыть доступ робота к версиям для печати в robots.txt. Если страницы на печать выводятся через GET-параметр ?print, используем для Яндекса директиву Clean-param, а для Google — Disallow:

Во втором примере реализации вывода на печать достаточно просто указать директиву Disallow для обоих роботов:

Ищите свой вариант работы с дублями

Одни и те же дубли можно закрыть от индексации разными способами. На практике работает и канонизация страниц, и редиректы, и директивы robots.txt, и метатег robots. Но каждый поисковик дает свои рекомендации.

Google не приветствует закрытие доступа к дублям с помощью robots.txt или метатега robots со значениями «noindex,nofollow», а предлагает использовать rel=»canonical» и 301 редирект. А вот Яндексу robots.txt «по душе» — здесь даже есть своя директива Clean-param, о которой мы рассказывали выше.

Ваша задача — найти способы, которые будут оптимальны именно в вашем случае. Например, если вы ориентируетесь на аудиторию стран Запада, Украины или Казахстана, лучше за основу брать рекомендации Google. Для России лучше придерживаться рекомендаций Яндекса.

Закрывать дубли сразу всем арсеналом инструментов точно не стоит — это лишняя работа, которая к тому же может привести к путанице в дальнейшем. Также не стоит излишне перегружать сервер 301 редиректами, поскольку это увеличит нагрузку на него.

Неявные дубли (контент на нескольких страницах различается, но незначительно)

Итак, мы разобрались с явными дублями — теперь расскажем о неявных, то есть тех, которые по разным URL отдают не идентичный, но очень похожий контент.

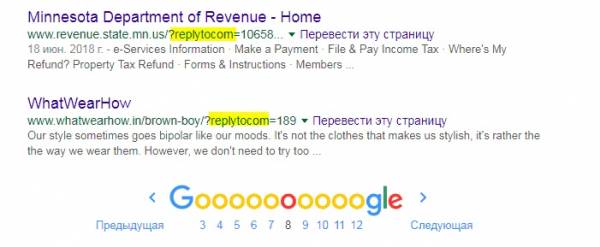

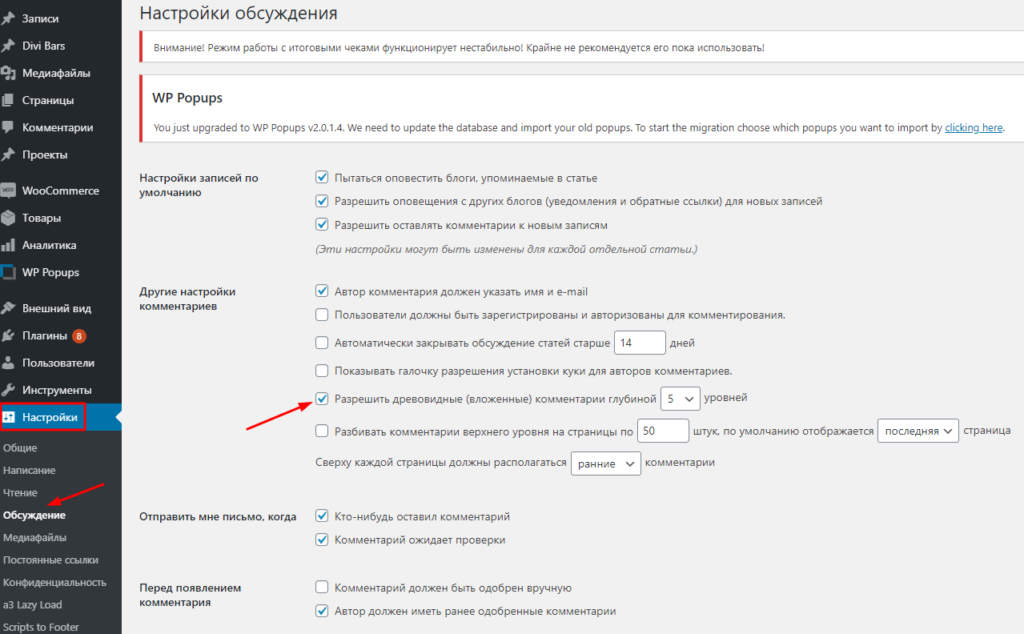

1. Дубли древовидных комментариев (replytocom)

Проблема актуальна для сайтов на WordPress. Когда кто-то отвечает на комментарий к записи, CMS генерирует новый URL. И чем больше ответов, тем больше дублирующихся URL, которые благополучно индексируются:

Что делать:

Вариант 1. Отключить древовидные комментарии в (перейти в «Настройки» / «Обсуждение», убрать галочку напротив «Разрешить древовидные (вложенные) комментарии глубиной N уровней» и не забыть сохранить изменения).

Но в этом случае снижается удобство комментирования. Поэтому лучше воспользоваться другими способами.

Вариант 2. Отключить штатный модуль комментариев и установить систему Disqus или аналоги (wpDiscuz, Cackle Comments и др.). Это и проблему с дублями устранит, и пользователям будет удобней.

Вариант 3. Изменить в коде CMS способ формирования URL страниц с ответами на комментарии и закрыть URL с replytocom от индексации с помощью метатега robots со значениями «noindex,nofollow». Для этой работы необходимо привлечь программиста.

2. Страницы товаров со схожими описаниями

Часто в магазинах товары отличаются лишь одной-двумя характеристиками (цвет, размер, узор, материал и т. п.). В итоге масса карточек товаров имеют однотипный контент. Это приводит к тому, что поисковик индексирует одну карточку (которую он считает наиболее подходящей), а похожие — нет.

Что делать:

Вариант 1. Объединить однотипные товары в одной карточке и добавить селектор для выбора отличающихся параметров. Это избавляет от дублей и упрощает навигацию для пользователей.

Вариант 2. Если не получается добавить селекторы, уникализируйте описания однотипных товаров. Начните с наиболее значимых товаров, которые обеспечивают наибольшую прибыль. Так вы постепенно заполните карточки товаров уникальными описаниями, и они не будут восприниматься как дубли.

Вариант 3. Если в карточках товаров повторяется определенная часть описания, и ее нет смысла уникализировать (например, базовые заводские параметры), эту часть можно скрыть от индексации с помощью тега:

Те же параметры, которые у товаров различаются, закрывать не стоит. Так поисковые системы будут видеть, что это разные товары.

Этот способ подходит скорее как временное решение. Особенно с учетом того, что тег noindex воспринимает только Яндекс. Вообще же лучше использовать первый или второй способ.

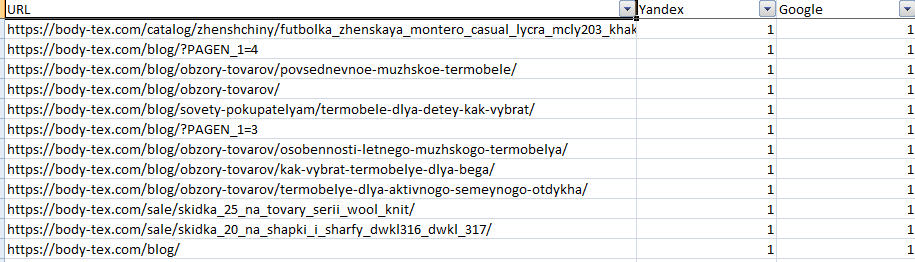

3. Страницы пагинации

Если у вас обширный каталог, то для удобства пользователей он разбивается на страницы. Это и есть пагинация.

Для скрытия страниц пагинации от индексации эффективней всего использовать атрибут rel=»canonical» тега . В качестве канонической необходимо указывать основную страницу каталога.

Дополнительно обезопасить сайт от появления дублей страниц пагинации в индексе можно при помощи генерации уникальных метатегов title и description и заголовков h1 по следующему шаблону:

- [Title основной страницы пагинации] – номер страницы пагинации;

- [Description основной страницы пагинации] – номер страницы пагинации;

- h1 основной страницы пагинации – номер страницы пагинации.

При оптимизации страниц пагинации также нужно учесть два важных момента:

- Не стоит добавлять на страницы пагинации уникальные тексты. Это лишняя трата времени и денег — контент на этих страницах и так различается (разные товары). Дело не в уникальном контенте, а в том, что пользователю нет смысла попадать из поиска на 3-ю или 10-ю страницу каталога. Ему важно начать с начала, а потом он уже сам решит, двигаться дальше или нет.

- Если в интернет-магазине размещены SEO-тексты на категориях товаров, они должны отображаться только на первой странице, чтобы избежать дублирования контента.

Мы рассмотрели основные дубли. Но вариантов может быть множество. Главное — понимать, как они формируются, как с ними бороться и с помощью каких инструментов выявить.

Как выявить дубли страниц

Сложного в этом ничего нет. Покажем несколько способов — выбирайте любой.

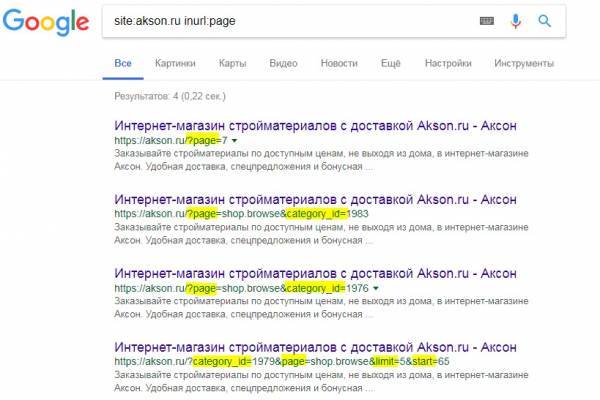

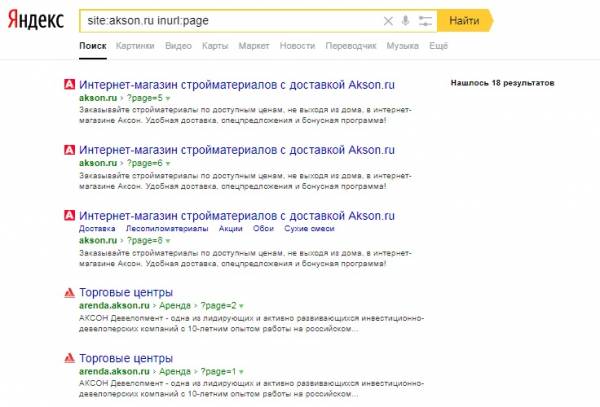

Способ 1. «Ручной»

Зная особенности своей CMS, можно быстро вручную найти дубли в поисковиках. Для этого введите в поисковой строке такой запрос:

Например, мы знаем, что на сайте URL страниц пагинации формируются с помощью GET-запроса ?page=. Вводим в Google запрос и находим 4 дубля:

Также мы узнали, что в дублирующихся страницах встречаются запросы ?limit=, ?start=, ?category_id= — по ним тоже стоит проверить сайт на наличие дублей.

То же самое делаем в Яндексе (здесь уже 18 дублей):

Этот способ хорошо подходит для экспресс-анализа сайта. Для системной работы используйте другие способы.

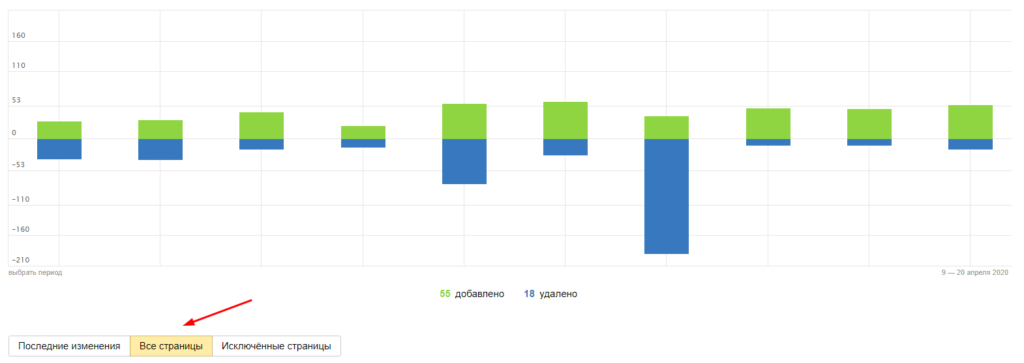

Способ 2. Яндекс.Вебмастер

Сообщения о дублях страниц, которые обнаружил на сайте робот Яндекса, появляется в разделе «Диагностика». Например, так выглядит уведомление о страницах с одинаковыми title и description:

Также Яндекс предупредит о наличии на сайте страниц с незначащими GET-параметрами.

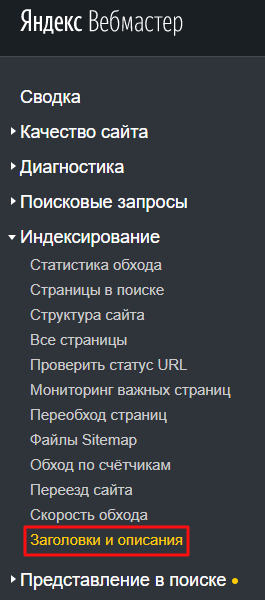

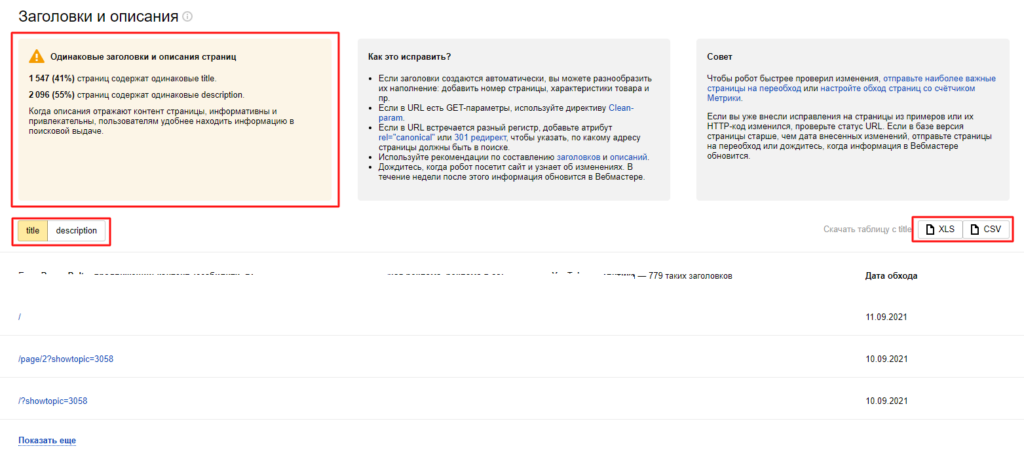

Примеры страниц с одинаковыми тегами title и description собраны в разделе «Индексирование» / «Заголовки и описания»:

При наличии дублей метатегов, здесь будет информация о количестве затронутых страниц (это же уведомление будет в разделе «Сводка»), примеры и рекомендации по исправлению. Таблицу с URL можно выгрузить в форматах XLS и CSV.

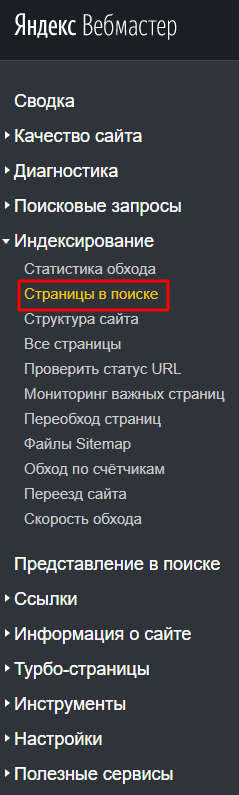

Разумно не ждать уведомлений и самостоятельно выявить дубли страниц с помощью Вебмастера. Алгоритм несложный:

- Перейдите в раздел «Индексирование» / «Страницы в поиске»:

- Активируйте вкладку «Все страницы» и выгрузите отчет в формате XLS:

- Пройдитесь по списку и найдите «подозрительные» URL. Для удобства активируйте фильтры по частям URL, указывающим на дублирование.

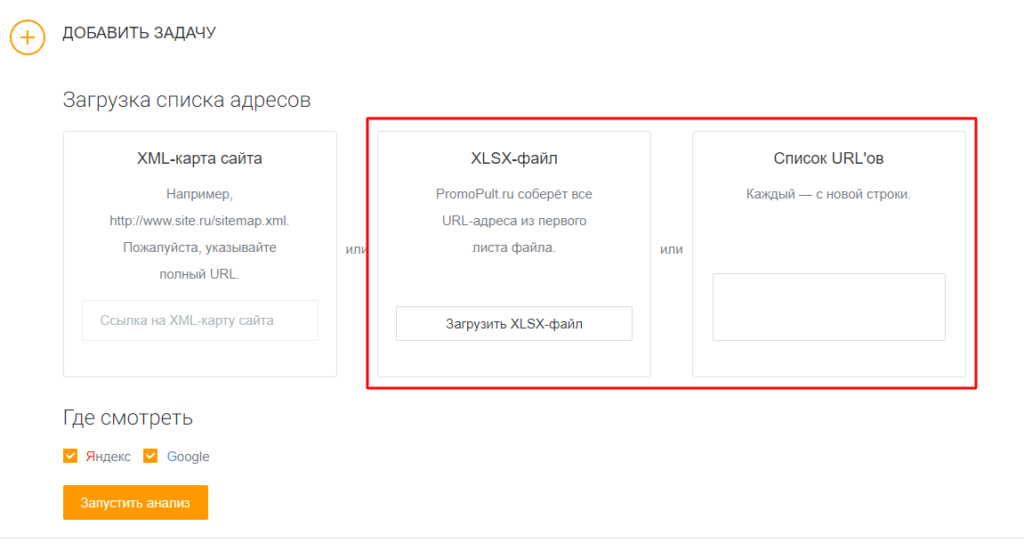

Способ 3. Парсинг проиндексированных страниц

При отслеживании индексации в панели Яндекса проблематично сопоставить данные с Google — приходится вручную перепроверять, проиндексирован ли здесь дубль. Избежать такой проблемы позволяет парсер проиндексированных страниц от PromoPult.

Что нужно сделать:

- выгрузите список проиндексированных URL из Яндекс.Вебмастера;

- загрузите этот список в инструмент от PromoPult — списком или с помощью XLSX-файла (подробная инструкция по использованию инструмента);

- запустите анализ и скачайте результат.

В этом примере страницы пагинации проиндексированы и Яндексом, и Google. Решение — настроить канонизацию для страниц пагинации и по возможности уникализировать метаданные.

Используя парсер от PromoPult, вы поймете, дублируются страницы в обоих поисковиках или только в одном. Это позволит подобрать оптимальные инструменты решения проблемы.

Если нет времени/опыта разбираться с дублями

Если у вас нет времени на то, чтобы разобраться с дублями, закажите аудит сайта — помимо наличия дублей вы получите массу полезной информации о своем ресурсе: наличие ошибок в HTML-коде, заголовках, метатегах, структуре, внутренней перелинковке, юзабилити, оптимизации контента и т. д. В итоге у вас на руках будут готовые рекомендации, выполнив которые, вы сделаете сайт более привлекательным для посетителей и повысите его позиции в поиске.

Еще один вариант — запустить поисковое продвижение сайта в SEO-модуле PromoPult. Специалисты системы выполнят более 70 видов работ по оптимизации сайта (в том числе устранят дубли). В итоге вы получите привлекательный для пользователей сайт, который будет стабильно расти в поиске и получать бесплатный трафик.

Источник